像 GPT-4o 这样的模型训练成本约为 1 亿美元,Anthropic 最新严打的大模型训练成本可能高达 10 亿美元。

前段时间震惊海外的 DeepSeek V3 最亮眼的是大幅压缩的预训练成本,也使用了 2000 多个 H800GPU、2 个月时间和 550 万美元。

众所知识,模型参数越大、精度越高,做推理时所需的显卡性能越强(显存、算力、带宽)。

大模型按模型参数量分为:亿级(kaiyun官网中国 开云网址比如常见的 0.5B)、十亿级(4B、7B、8B)、百亿级(14B、32B、72B)、千亿级(110B、405B)等等。

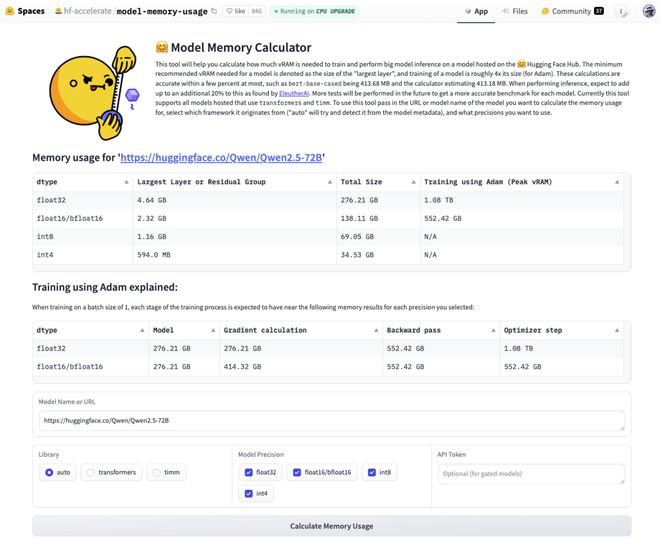

一个大模型,比如 Qwen2.5-72B,需要多少 GPU 显存才可以推理和训练呢?

在网页中输入模型名称或 URL,该工具将提供内存使用情况的全面细分,包括数据类型、最大层、总大小和使用不同优化器的训练内存使用情况。比如我让其计算阿里Qwen2.5-72B的显存需求,结果如下:

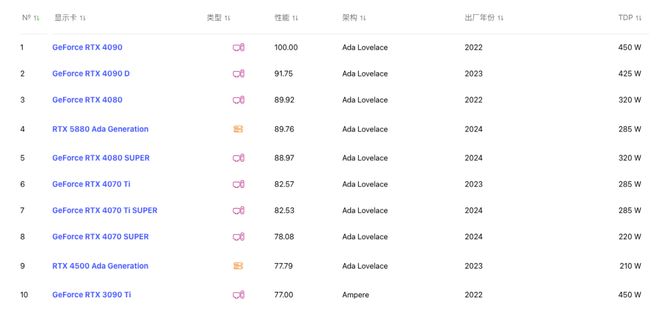

一是NVIDIA 显卡排行榜,此网站能实时对比各种型号显卡,主要是英伟达消费级显卡。

二是大语言模型推理专用显存天梯,主要关注内存带宽,这里还有对苹果芯片的测评

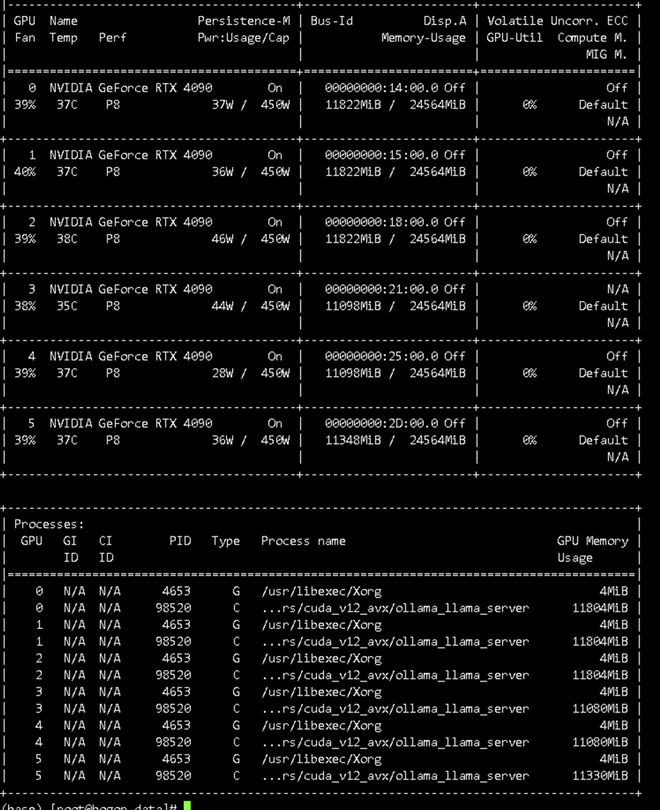

目前国内企业都还在各显神通拿A100,路子不硬就L40、A6000,是在没招的就消费级4090了。

个人啊,咬咬牙4090吧,不过个人没必要一定本地离线跑大模型,毕竟现在大模型api都约等于白送的白菜价。

特别声明:以上内容(如有图片或视频亦包括在内)为自媒体平台“网易号”用户上传并发布,本平台仅提供信息存储服务。

被谢贤养了12年,用青春换来2000万的Coco,已经走上了另一条大道

创历史,12岁小孩姐夺200米蝶泳全国冠军,甩陈妤颉2条街

特朗普指责拜登团队成员“犯叛国罪”:通过接管拜登的自动签名笔窃取总统权力

NVIDIA 的下一个“专注于中国市场”的方案可能是“B40”AI 芯片

Realtek展示新一代 PCIe 5.0 NVMe 和 USB 3.2 Gen 2x2 SSD 控制器

中节能万润股份2024年度股东大会通过10项议案 含利润分配及回购计划

《编码物候》展览开幕 北京时代美术馆以科学艺术解读数字与生物交织的宇宙节律